DEEPFAKES: algoritmos que delinquen

Por Guadalupe Melián – Licenciada en Criminalistica.

En el presente artículo, veremos cómo el avance de la inteligencia artificial (I.A) genera además de resultados positivos, efectos negativos. El ejemplo más claro de ello, es el deepfake; «una grabación de video, foto o audio que parece real pero que ha sido manipulada con IA», según la definición de la Oficina de Responsabilidad del Gobierno de EE. UU.

De esta manera, se propone la necesidad de incorporarlo como delito en la legislación penal argentina, en línea con iniciativas internacionales así como la Ley “Take It Down Act” de Estados Unidos y, finalmente abordaremos las consecuencias éticas, jurídicas y sociales de este fenómeno.

Etimología

El adjetivo “profundo” viene del latín profundus, que significa hondo, bajo, abismal, lo que llega o se dirige hacia el fondo. De esta manera, una deepfake o mentira profunda sería aquella que llega hasta los extremos de la recreación de lo real, cuando la percepción convencional no puede determinar si es verdad o falaz. El mejor ejemplo es usar la cara de una persona famosa para colocarla en el cuerpo de otra. Con ordenadores convencionales, cualquier persona puede realizar vídeos fake que parezcan prácticamente reales (Cerdán Martínez y Padilla Castillo, 2019).

Por otro lado, según el Cambridge English–Spanish Dictionary (s.f.), fake se refiere a “un objeto que está hecho para parecer real o valioso con el fin de engañar a las personas”.

Origen

En principio, es importante saber cómo, cuándo y dónde comenzó la difusión de esta práctica delictiva; deepfake. Según Visus (2021), en el año 2014 Ian Goodfellow, un estudiante de doctorado de la Universidad de Montreal, abordó de forma pionera la generación de imágenes con el enfoque de redes neuronales generativas adversas (G.A.N.). Goodfellow entrenó dos redes neuronales con una misma base de datos de imágenes para luego crear otras nuevas. Enfrentó las dos redes para que identificaran qué imágenes eran reales y cuáles eran ficticias como un juego digital del gato y ratón.

Sin embargo, fue en 2017 que un usuario anónimo de Reddit [1]utilizó el deep learning (aprendizaje profundo) para intercambiar las caras de actrices famosas con las de las actrices originales en escenas de películas para adultos. Por ejemplo; se han hecho videoclips de la ex primera dama Michelle Obama así como también del ex presidente Barack Obama, de la hija del expresidente Donald Trump; Ivanka Trump, o de la duquesa de Cambridge; Kate Middleton.

[1] Sitio web de marcadores sociales y agregador de noticias donde los usuarios pueden añadir textos, imágenes, videos o enlaces.

Se tomó una imagen real de Barack Obama y el audio fue modificado, con un discurso del actor Jordan Peele, que llama “dipshit” (“idiota” en castellano) a Donald Trump. El resultado es perfecto y parece que Obama ha pronunciado todo lo que se escucha. Fue creado por BuzzFeed, que dijo haber editado el vídeo en sólo 56 horas (Cerdán Martínez y Padilla Castillo, 2019).

En definitiva, cuando hablamos de “deepfake” nos referimos a una técnica emergente (basada en I.A), al ser reciente.

El vacío legal en Argentina y el contraste con la Ley “Take It Down Act”

Como mencioné al principio de este artículo, debe existir una propuesta inmediata para incorporar los contenidos denominados deepfakes (creados con IA) como delito en la legislación argentina.

Según Álvarez (2025), en el mes de julio del corriente año, se determinó mediante un fallo de la Cámara Penal de Zárate-Campana que sea considerado delito dentro del art. 128 del Código Penal (contempla las representaciones de menores en situaciones sexuales explicitas, sin importar como fueron creadas); una causa en la que un hombre fue acusado de publicación y distribución de representaciones de menores de dieciocho años en actividades sexuales.

La defensa del acusado alegó que no se había acreditado la existencia de víctimas reales y que el contenido podría haber sido creado digitalmente, o incluso adulterado, mediante herramientas tecnológicas como la inteligencia artificial o imágenes generadas por computadora (CGI).

Además, advirtieron que permitir este tipo de contenidos, incluso si fueran creados artificialmente, conduciría a normalizar la pedofilia y, en definitiva, pone en peligro el bien jurídico protegido: la libertad e integridad sexual de las infancias.

Este fallo se basó en las siguientes convenciones internacionales:

- Convención Internacional sobre Los Derechos de los Niños- Ley 23.849

- El Protocolo Facultativo de la Convención sobre los Derechos del Niño-Ley 25.763

- Convenio sobre Ciberdelito de Budapest- Ley 27.411

Asimismo, la Unión Europa está analizando la necesidad de actualizar sus leyes para proteger la integridad de los menores, ya que el aumento de imágenes y videos pornográficos de menores mediante IA, está en ascenso.

Por otro lado, Martínez (2025) analizó la nueva Ley federal Take It Down Act en Estados Unidos, diseñada específicamente para hacer frente a la difusión de imágenes íntimas no consentidas (NCII, por sus siglas en inglés), incluidos los deepfakes generadas por IA. Declara ilegal compartir imágenes o vídeos sexualmente explícitos de una persona sin su consentimiento, independientemente de que las imágenes sean reales o manipuladas con inteligencia artificial.

Los sitios web, las aplicaciones y las redes sociales están ahora obligados a retirar los contenidos ofensivos en un plazo de 48 horas, a partir de la recepción de una solicitud válida de retirada de una víctima.

Análisis estadístico del consumo de deepfakes en 2024

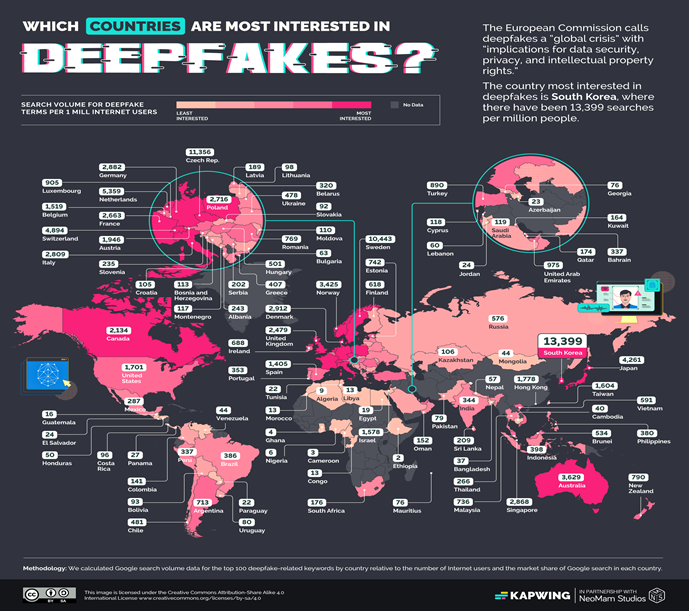

Kapwing; una plataforma moderna de creación de videos que ayuda a los equipos a crear contenido excelente más rápido, realizó un estudio en el año 2024, con el objetivo de saber qué países consumieron más deepfakes.

“Primero, evaluamos el interés en los deepfakes para cada país con datos disponibles. De estos, encontramos tres que se destacan: Corea del Sur (13,399), República Checa (11,356) y Suecia (10,443) son los únicos lugares con más de 10,000 búsquedas relacionadas con deepfakes por millón de personas. En comparación, el cuarto país más interesado es Holanda, con 5.359 búsquedas por millón. Hay 18 países que realizan más búsquedas por millón que los EE. UU. (1,701)” (Curtis, 2025).

Podemos observar en la imagen anterior, que Argentina se posiciona como el país de América Latina que hasta el año pasado, consumía más deepfakes, con 713 búsquedas por millón de habitantes.

Conclusión

Los deepfakes representan una de las manifestaciones más complejas y disruptivas de la inteligencia artificial, con un impacto creciente en múltiples esferas de la vida social.

Las consecuencias éticas de su uso indebido abarcan desde la manipulación de la opinión pública hasta la vulneración de la intimidad y la dignidad de las personas, afectando especialmente a figuras públicas, menores y víctimas de violencia digital.

Desde el punto de vista jurídico, plantea vacíos normativos que requieren una urgente actualización legislativa en torno a la protección de la imagen, la privacidad y la integridad de los datos.

Socialmente, fomenta la desinformación y contribuye a una crisis generalizada de credibilidad, donde incluso los registros audiovisuales más auténticos podrían ser puestos en duda.

Por todo ello, es sumamente necesario que esta generación impulse un abordaje multidisciplinario que articule la innovación tecnológica con principios éticos sólidos, una regulación jurídica adecuada y una educación digital que permita a la sociedad identificar, comprender y enfrentar los riesgos de este fenómeno emergente.

Referencias bibliográficas

- Álvarez, R. (2 de julio del 2025). La Justicia confirmó que las imágenes de abuso infantil generadas con IA son delito y sentó un precedente. TN – Todo Noticias. https://tn.com.ar/tecno/novedades/2025/07/02/la-justicia-confirmo-que-las-imagenes-de-abuso-infantil-generadas-con-ia-son-delito-y-sento-un-precedente/

- Cambridge Dictionary. (s.f.). Fake. Recuperado de https://dictionary.cambridge.org/dictionary/english-spanish/fake

- Cerdán Martínez, V., & Padilla Castillo, G. (2019). Historia del fake audiovisual: deepfake y la mujer en un imaginario falsificado y perverso. [Artículo académico]. Universidad Complutense de Madrid. https://docta.ucm.es/rest/api/core/bitstreams/b98b8397-712f-4373-953b-5483bb9a6a39/content

- Curtis, L. (2025). Informe de interés global de deepfake 2024. Kapwing. https://www.kapwing.com/blog/deepfake-global-interest-report-2024/

- Fagan, K. (17 de abril del 2017). Un video viral que parecía mostrar a Obama llamando a Trump un «bajón» muestra una nueva tendencia inquietante llamada «deepfakes». Business Insider. https://www.businessinsider.com/obama-deepfake-video-insulting-trump-2018-4

- Martínez, A. (20 de mayo del 2025). Take It Down Act: la ley que criminaliza los deepfakes y la pornovenganza. El País. https://elpais.com/us/2025-05-20/take-it-down-act-la-ley-que-criminaliza-los-deepfakes-y-la-pornovenganza.html

- Visus, A. (julio, 2021). Deep fakes: qué es, cómo se crean y cuáles fueron los primeros. ESIC. https://www.esic.edu/rethink/tecnologia/deep-fakes-que-es-como-se-crean-primeros-y-futuros

Aviso Legal: El contenido del presente articulo no fue redactado por #ElAnalista, siendo el mismo de exclusiva autoría y propiedad intelectual de su creador. El artículo podría no reflejar las opiniones de #ElAnalista como organismo.